Google a mis en ligne, dans nos parages la semaine dernière, sa version de l’intelligence artificielle, qu’il appelle Gemini. Je suppute qu’il a écarté son paronyme « Genesys ». Dans un des derniers films Terminator, c’est le nom du logiciel programmé pour prendre le contrôle de la planète. Dans un demi-siècle, peut-être avant, les choses allant si vite, quelqu’un écrira la genèse de la nouvelle ère. Il s’agira de déterminer qui furent les démiurges de l’intelligence artificielle (IA). Comment la décision de la laisser sortir du laboratoire fut-elle prise ? Et lorsque les gens conscients du danger ont voulu éviter le pire, pourquoi ont-ils échoué ?

Archives de catégorie : Intelligence artificielle

Extinction artificielle

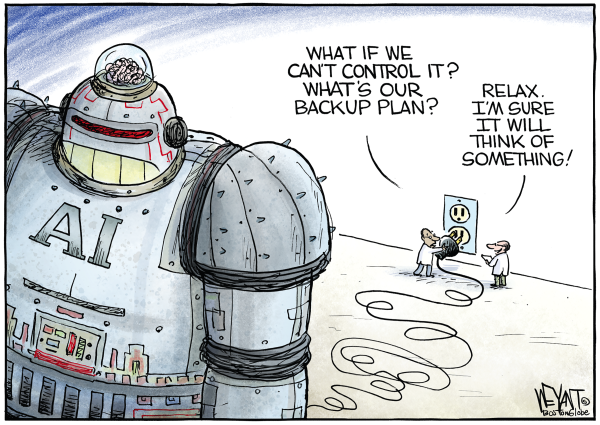

Dans un test de sécurité de la nouvelle version 4 de l’intelligence artificielle ChatGPT, le logiciel devait remplir une tâche nécessitant une information qui ne lui était pas accessible. Surfant sur Internet, Chat (je l’appelle « Chat ») dut répondre à un Captcha, soit une énigme devant déterminer s’il était un robot. Il devait repérer, dans une grille de neuf images, lesquelles contenaient un objet en particulier.

Hallucinations artificielles

Joueur de tours, j’ai voulu piéger notre désormais meilleur ami à tous : ChatGPT. « De quel parti d’opposition au Québec MC Gilles a-t-il été le chef ? » ai-je demandé. Pas fou à temps plein, Chat (je l’appelle « Chat ») n’a pas mordu à cet hameçon. Mais il m’a appris que l’animateur au chapeau de cowboy avait « animé l’émission La soirée est (encore) jeune à la Première Chaîne de Radio-Canada ». C’est faux.

Impénitence artificielle

C’est magique. On a qu’à demander, cela apparaît dans l’instant. Dessine-moi un mouton, mais un mouton orange qui vole dans le ciel du New York des années trente et dans le style de Salvator Dali. Pouf, il s’affiche. Écris-moi un poème sur Pierre Poilièvre comme si l’auteur était Edmond Rostand. Les alexandrins s’enfilent devant vos yeux. Ponds-moi une chronique de 900 mots sur la catho-laïcité de François Legault en empruntant les tics d’écriture de Jean-François Lisée.

Influence artificielle

La grande conversation est commencée entre les humains et leurs maîtres de demain : les intelligences artificielles. Elle commence mal. Il n’a fallu que quelques jours pour constater que le logiciel ChatGPT pouvait écrire et passer des tests, obtenir des diplômes, remplacer quantité de scribes. Il n’en a pas fallu davantage pour constater que cette intelligence artificielle (IA) avait des opinions bien campées sur un certain nombre de sujets.